Wat is de M5Stack LLM Module?

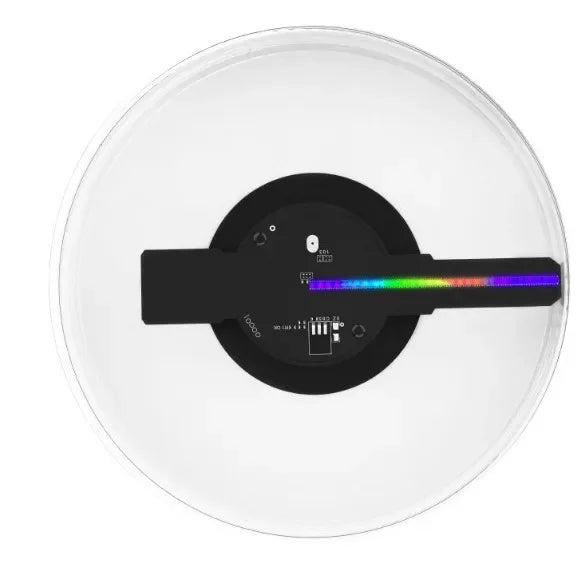

De M5Stack LLM Module is een geïntegreerde offline Large Language Model (LLM) inferentiemodule die is ontworpen voor eindpunten die efficiënte en intelligente interactie vereisen. Of het nu gaat om slimme huizen, spraakassistenten of industriële besturing, Module LLM biedt een soepele en natuurlijke AI-ervaring zonder afhankelijk te zijn van de cloud, wat privacy en stabiliteit waarborgt. Geïntegreerd met het StackFlow-framework en Arduino/UiFlow-bibliotheken, kunnen intelligente functies eenvoudig worden geïmplementeerd met slechts een paar regels code.

Aangedreven door de geavanceerde AX630C SoC-processor, integreert het een 3,2 TOPs hoogefficiënte NPU met native ondersteuning voor Transformer-modellen om complexe AI-taken moeiteloos af te handelen. Voorzien van 4GB LPDDR4-geheugen (1GB beschikbaar voor gebruikersapplicaties, 3GB toegewezen voor hardwareversnelling) en 32GB eMMC-opslag, ondersteunt het parallel laden en sequentiële inferentie van meerdere modellen voor soepele multitasking. De hoofdchip is vervaardigd met behulp van TSMC's 12nm-proces, met een operationeel energieverbruik van ongeveer 1,5W, waardoor het zeer efficiënt is en geschikt voor langdurige werking.

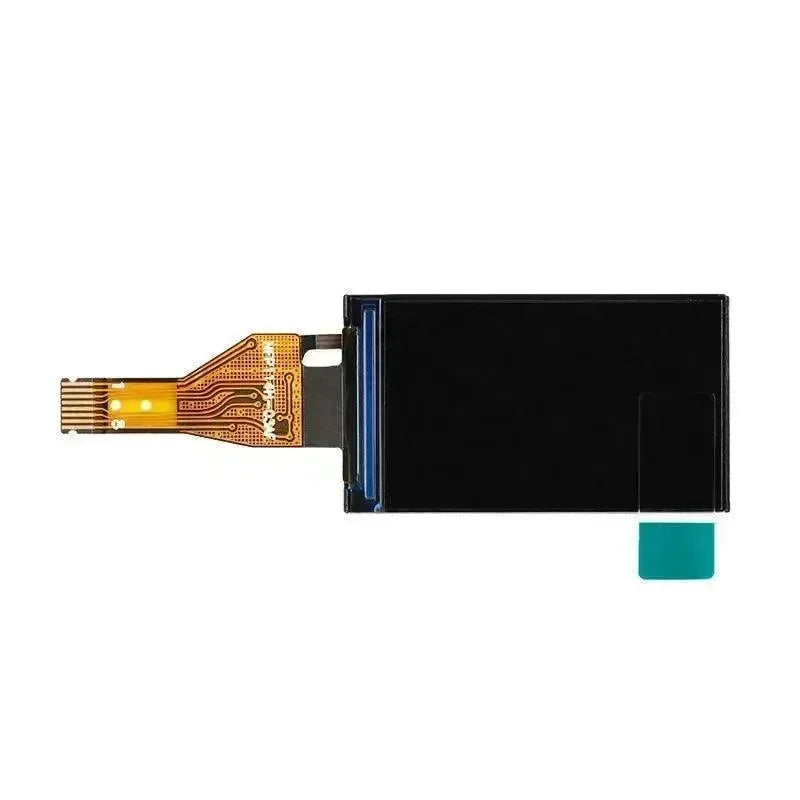

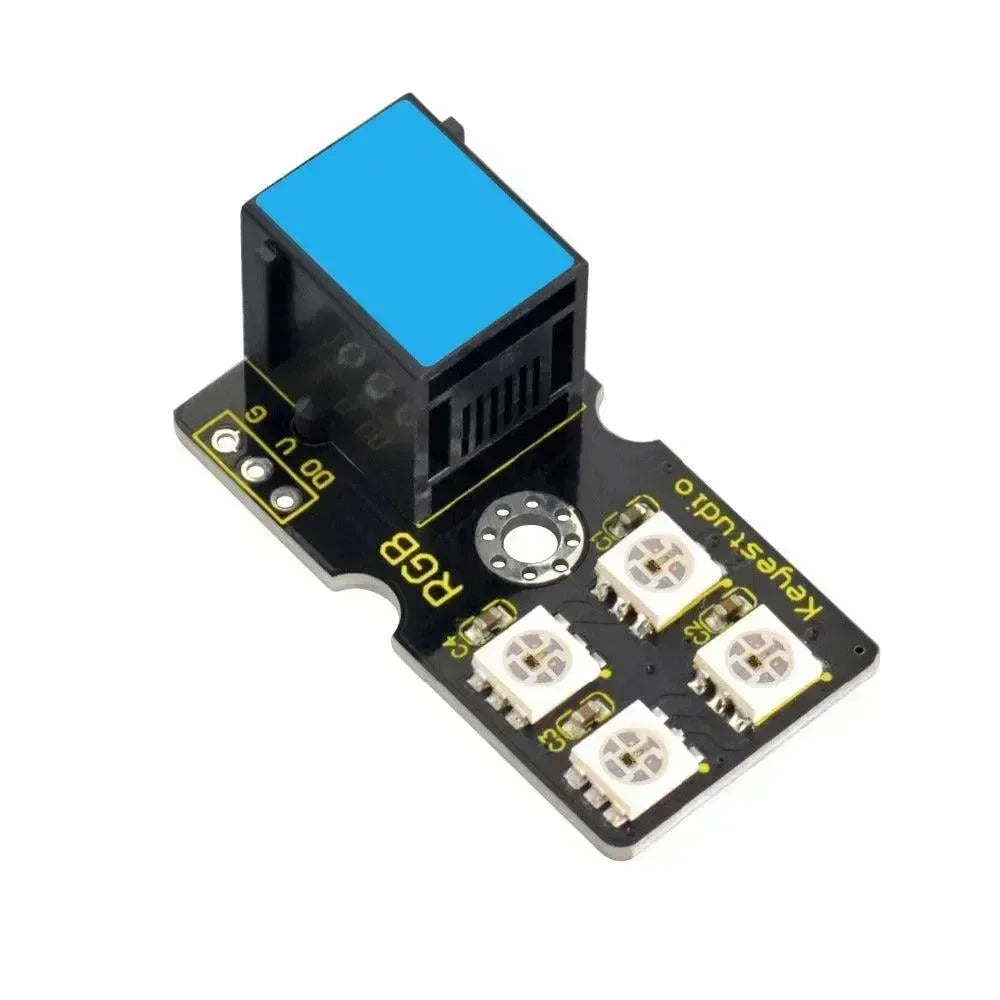

Het heeft een geïntegreerde microfoon, luidspreker, TF-geheugenkaart, USB OTG en RGB-statuslampje om spraakinteractie en gegevensoverdracht voor een breed scala aan toepassingen te ondersteunen. De module biedt flexibele uitbreiding: de on-board SD-kaartsleuf ondersteunt koude/warme firmware-upgrades, en de UART-communicatie-interface vereenvoudigt de verbinding en het debuggen, wat zorgt voor continue optimalisatie en uitbreiding van de functionaliteit van de module. De USB-poort ondersteunt master-slave auto-switching, fungeert als een debugpoort en maakt ook verbinding met extra USB-apparaten zoals camera's mogelijk. Gebruikers kunnen het LLM-debuggingkit aanschaffen om een 100Mbps Ethernet-poort en een kernel-serieel poort toe te voegen om het als een SBC te gebruiken.

Overzicht

Hardware:

Microcontroller: Typisch heeft een AX630C@Dual Cortex A53 1.2 GHz MCU, wat MAX.12.8 TOPS @INT4 en 3.2 TOPS @INT8 is.

Geheugen: 4GB LPDDR4 (1GB systegeheugen + 3GB toegewezen voor hardwareversnelling).

Opslag: 32GB eMMC5.1

Upgrade Poort: SD-kaart / Type-C poort

Functies

-

Offline gevolgtrekking, 3,2T@INT8 precisierekenkracht

-

Geïntegreerde KWS (wake word), ASR (spraakherkenning), LLM (groot taalmodel), TTS (tekst-naar-spraakgeneratie)

-

Parallelle verwerking van meerdere modellen

-

Ingebouwde 32 GB eMMC-opslag en 4 GB LPDDR4-geheugen

-

Ingebouwde microfoon en luidspreker

-

Seriële communicatie

-

Firmware-upgrade voor SD-kaart

-

Ondersteunt ADB-foutopsporing

-

RGB-indicatielampje

-

Ingebouwd Ubuntu-systeem

-

Ondersteunt OTG-functionaliteit

-

Compatibel met Arduino/UIFlow

Gebruik en Ontwikkeling

-

Hardware-installatie:

-

Verbind de LLM-module met je M5Stack-core of een ander compatibel apparaat via de Grove-poort.

-

Zorg ervoor dat je een antenne hebt aangesloten voor optimale reikwijdte.

-

Softwareontwikkeling:

-

Installeer de LoRaWAN-bibliotheek voor ESP32 in de Arduino IDE of gebruik de geschikte firmware voor MicroPython als dit wordt ondersteund.

-

Configureer de module met uw LoRaWAN-netwerkinstellingen (bijv. DevEUI, AppEUI, AppKey).

-

Schrijf code om LoRaWAN-communicatie te verwerken, inclusief het aansluiten op het netwerk, het verzenden van gegevens en het ontvangen van opdrachten.

-

Integratie met IoT-platforms:

-

Veel LoRaWAN-netwerken integreren met IoT-platforms zoals The Things Network (TTN) of commerciële netwerkoperators. Stel uw apparaat in om te communiceren met deze platforms voor gegevensbeheer en analyses.

Conclusie

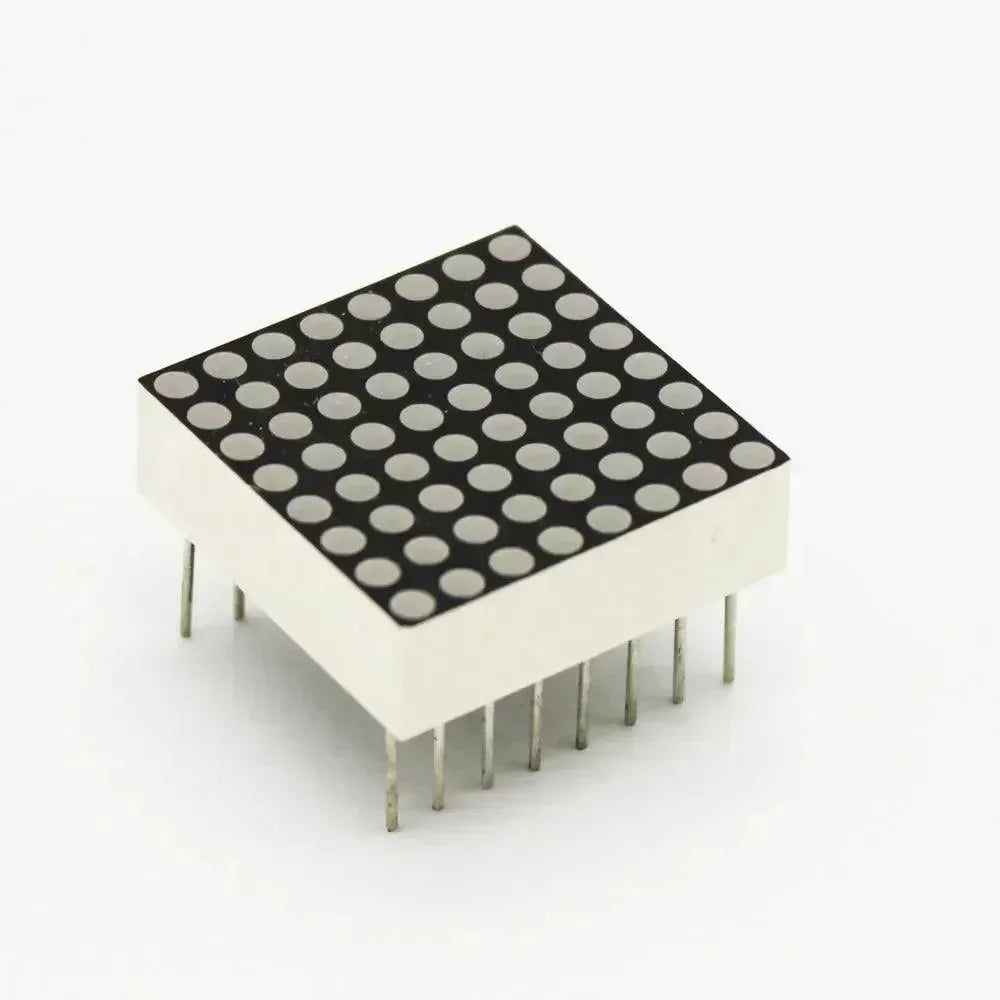

De M5Stack LLM Module is multi-model compatibel en wordt standaard geleverd met het Qwen2.5-0.5B spraakmodel. Het biedt KWS (wake word), ASR (automatische spraakherkenning), LLM (groot taalmodel), en TTS (tekst-naar-spraak) functionaliteit, met ondersteuning voor standalone oproepen of automatische pipeline-overdracht voor gebruiksgemak bij ontwikkeling. Toekomstige ondersteuning omvat Qwen2.5-1.5B, Llama3.2-1B en InternVL2-1B modellen, waarmee hot model updates mogelijk zijn om gelijke tred te houden met communitytrends en verschillende complexe AI-taken aan te pakken. Visuele mogelijkheden omvatten ondersteuning voor CLIP, YoloWorld, en toekomstige updates voor DepthAnything, SegmentAnything en andere geavanceerde modellen om intelligente detectie en analyse te verbeteren.

Plug and play met M5-hosts, de LLM-module biedt een gebruiksvriendelijke AI-interactie-ervaring. Gebruikers kunnen het snel integreren in bestaande slimme apparaten zonder complexe instellingen, waardoor intelligente functionaliteit mogelijk wordt en de intelligentie van het apparaat wordt verbeterd. Dit product is geschikt voor offline spraakassistenten, tekst-naar-spraak-conversie, slimme huisbediening, interactieve robots en meer.

Hoe gebruik je de M5Stack LLM-module?

Vandaag laat ik je zien hoe je de M5Stack UIflow kunt gebruiken om de M5Stack LLM (large language model) Module te testen.

Hardware

Software

Weet je niet hoe je het moet installeren?

Arduino

Ontwikkelingsraamwerk

Ontwikkelingsbronnen

Aanbevolen artikelen

openelab.de

openelab.de

openelab.com

openelab.com