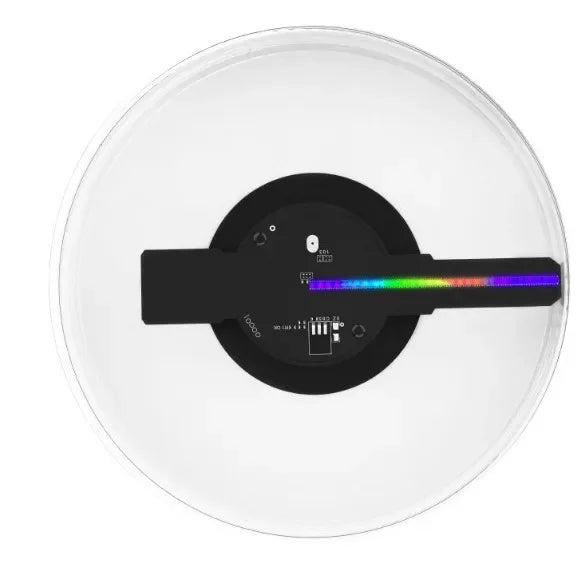

¿Qué es el módulo LLM de M5Stack?

El M5Stack LLM Module es un módulo de inferencia de Modelo de Lenguaje Grande (LLM) integrado y offline, diseñado para puntos finales que requieren interacción eficiente e inteligente. Ya sea para hogares inteligentes, asistentes de voz o control industrial, el Módulo LLM proporciona una experiencia de IA fluida y natural sin depender de la nube, asegurando privacidad y estabilidad. Integrado con el marco StackFlow y las bibliotecas Arduino/UiFlow, las funciones inteligentes se pueden implementar fácilmente con solo unas pocas líneas de código.

Impulsado por el avanzado AX630C procesador SoC, integra un NPU de alta eficiencia de 3.2 TOPs con soporte nativo para modelos Transformer para manejar tareas complejas de IA con facilidad. Equipado con 4GB de memoria LPDDR4 (1GB disponible para aplicaciones de usuario, 3GB dedicados para aceleración de hardware) y 32GB de almacenamiento eMMC, soporta carga paralela e inferencia secuencial de múltiples modelos para un multitasking fluido. El chip principal se fabrica utilizando el proceso de 12nm de TSMC, con un consumo de energía operativo de aproximadamente 1.5W, lo que lo hace altamente eficiente y adecuado para operación a largo plazo.

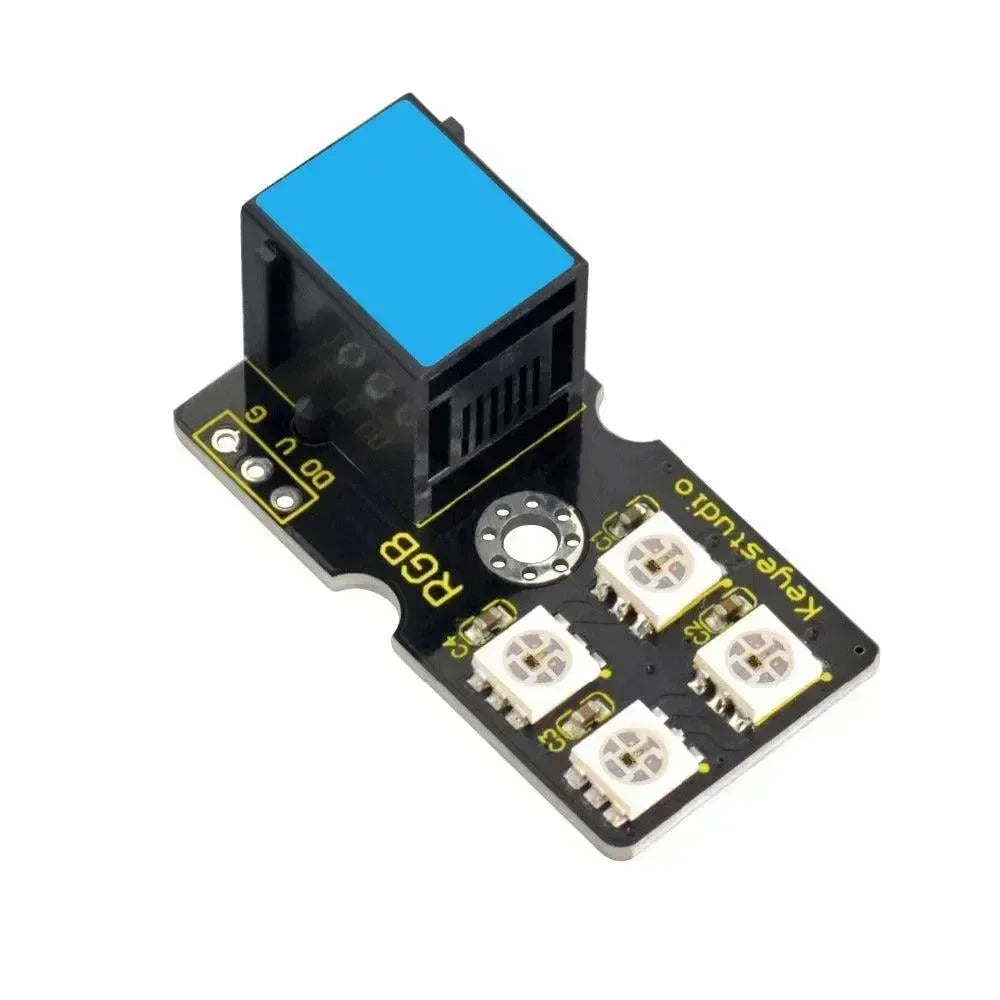

Cuenta con un micrófono integrado, altavoz, tarjeta de memoria TF, USB OTG y luz de estado RGB para soportar la interacción por voz y la transferencia de datos para una amplia gama de aplicaciones. El módulo ofrece una expansión flexible: la ranura para tarjeta SD en la placa admite actualizaciones de firmware en frío/caliente, y la interfaz de comunicación UART simplifica la conexión y depuración, asegurando una optimización y expansión continua de la funcionalidad del módulo. El puerto USB admite conmutación automática maestro-esclavo, actuando como un puerto de depuración y permitiendo la conexión a dispositivos USB adicionales como cámaras. Los usuarios pueden adquirir el kit de depuración LLM para agregar un puerto Ethernet de 100Mbps y un puerto serie del kernel para usarlo como un SBC.

Descripción general

Hardware:

Microcontrolador: Típicamente cuenta con un AX630C@Dual Cortex A53 1.2 GHz MCU, que es MAX.12.8 TOPS @INT4 y 3.2 TOPS @INT8.

Memoria: 4GB LPDDR4 (1GB de memoria del sistema + 3GB dedicados para la aceleración de hardware).

Almacenamiento: 32GB eMMC5.1

Puerto de Actualización: tarjeta SD / puerto Type-C

Características

-

Inferencia fuera de línea, potencia informática de precisión 3.2T@INT8

-

KWS integrado (palabra de activación), ASR (reconocimiento de voz), LLM (modelo de lenguaje grande), TTS (generación de texto a voz)

-

Procesamiento paralelo multimodelo

-

Almacenamiento eMMC de 32 GB integrado y memoria LPDDR4 de 4 GB

-

Micrófono y altavoz integrados

-

Comunicación serial

-

Actualización del firmware de la tarjeta SD

-

Admite depuración ADB

-

Luz indicadora RGB

-

Sistema Ubuntu integrado

-

Admite funcionalidad OTG

-

Compatible con Arduino/UIFlow

Uso y Desarrollo

-

Configuración del hardware:

-

Conecta el módulo LLM a tu núcleo M5Stack u otro dispositivo compatible a través del puerto Grove.

-

Asegúrate de tener una antena conectada para un rango óptimo.

-

Desarrollo de software:

-

Instala la biblioteca LoRaWAN para ESP32 en el IDE de Arduino o utiliza el firmware apropiado para MicroPython si es compatible.

-

Configura el módulo con la configuración de tu red LoRaWAN (por ejemplo, DevEUI, AppEUI, AppKey).

-

Escribe código para manejar la comunicación LoRaWAN, incluyendo unirse a la red, enviar datos y recibir comandos.

-

Integración con plataformas IoT:

-

Muchas redes LoRaWAN se integran con plataformas IoT como The Things Network (TTN) o operadores de red comerciales. Configura tu dispositivo para comunicarte con estas plataformas para la gestión de datos y análisis.

Conclusión

El M5Stack LLM Módulo es compatible con múltiples modelos y viene preinstalado con el modelo de voz Qwen2.5-0.5B. Proporciona KWS (palabra de activación), ASR (reconocimiento automático de voz), LLM (modelo de lenguaje grande), y TTS (texto a voz) funcionalidad, con soporte para llamadas independientes o transferencia automática de canalización para facilitar el desarrollo. El soporte futuro incluye los modelos Qwen2.5-1.5B, Llama3.2-1B e InternVL2-1B, lo que permite actualizaciones de modelos en caliente para mantenerse al día con las tendencias de la comunidad y abordar diversas tareas complejas de IA. Las capacidades de visión incluyen soporte para CLIP, YoloWorld y futuras actualizaciones para DepthAnything, SegmentAnything y otros modelos avanzados para mejorar la detección y análisis inteligente.

Conectar y usar con hosts M5, el módulo LLM proporciona una experiencia de interacción con IA fácil de usar. Los usuarios pueden integrarlo rápidamente en dispositivos inteligentes existentes sin configuraciones complejas, lo que permite una funcionalidad inteligente y mejora la inteligencia del dispositivo. Este producto es adecuado para asistentes de voz offline, conversión de texto a voz, control de hogares inteligentes, robots interactivos y más.

¿Cómo usar el módulo LLM de M5Stack?

Hoy te mostraré cómo usar el M5Stack UIflow para probar el módulo LLM (modelo de lenguaje grande) de M5Stack.

Hardware

Software

¿No sabes cómo instalarlo?

Flujo de interfaz de usuario

Arduino

Actualización de firmware

Marco de Desarrollo

Recursos para el desarrollo

Artículos relacionados